4. Die Qualität der Regressionsgleichung (2/3)

Die Gesamtsumme der Quadrate SST kann man sich als Maß der Möglichkeiten vorstellen, um vom Mittelwert ausgehend den y-Wert bei einem bestimmten x-Wert abzuschätzen; je mehr der auftretenden Abweichungen durch die Regressionsgerade erklärt werden können, desto besser ist die Gleichung geeignet, um y-Werte bei gegebenen x-Werten zu schätzen. Demzufolge ist die Regressionsgleichung umso besser zur Erklärung der Variation der y-Werte als Funktion der x-Werte geeignet, je näher der Wert für SSR am SST-Wert liegt. Das Bestimmtheitsmaß zeigt die Anzahl der Residuen an, die durch die Regressionsgleichung erklärt werden.

In unserem Beispiel werden 85,95% der Abweichungen bei den GLAI-Daten für den Winterweizen und 79,42% für die Sommergerste erklärt, wenn wir einfache lineare Regression anwenden. Bessere Ergebnisse könnte man durch Anwendung einer Polynomfunktion höherer Ordnung erzielen.

Ein Problem beim Bestimmtheitsmaß ist es, dass die Größe der Stichprobe nicht berücksichtigt wird. Daher könnte man ausgehend von zwei Beobachtungen ein lineares Modell mit einer Regressionsgeraden finden, auf der die beiden Punkte genau liegen und man hätte einen Wert von 1,0 für R2. Selbstverständlich kann man sich jedoch nicht gut darauf verlassen, dass nur zwei Beobachtungen ausreichen, um die Ausgangsgesamtheit zu repräsentieren.

Um mit dieser Situation umzugehen, wird der F-Test als zuverlässigerer Test genutzt, um die Eignung der Regressionsgleichung zur Erklärung der Variation der y-Werte im Verhältnis zu den x-Werten zu erklären. Der F-Test wird eigentlich benutzt, um die Hypothese, dass der Zuwachs (b1) bei der Regression gleich Null ist, die sogenannte Nullhypothese, zu testen. Ist b1 = 0, dann besteht keine Beziehung zwischen unabhängiger und abhängiger Variable.

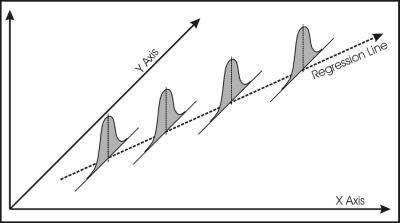

Die Nutzung des F-Tests basiert auf der Möglichkeit, auf zwei Schätzwerte für die Varianz der Residuen der Regression zu schließen. Die SSE liefert eine Schätzung dieser Varianz. Ist der Zuwachswert gleich Null, was bedeutet, dass die Regression nicht signifikant ist, so bildet die SSR die Grundlage für eine zweite Schätzung der Varianz der Residuen. Der F-Wert gibt das Verhältnis zwischen diesen beiden Varianzschätzugen an. Beträgt der F-Wert Null, würde die Nullhypothese angenommen, d.h. die Regression ist nicht signifikant; wird die Nullhypothese abgelehnt, kann die Regression als signifikant angesehen werden.